La surveillance n’est plus visibles mais est toujours bien ancrée dans nos sociétés modernes. Les données deviennent une ressource convoitable au sein d’une nouvelle économie : celle de la surveillance.

À l’ère des réseaux sociaux et du numérique omniprésent, nos interactions quotidiennes laissent derrière elles une multitude de traces. Loin d’être anodines, ces données participent à l’émergence d’un nouveau modèle de surveillance à la fois invisible, automatisé et profondément intégré à l’économie numérique. Cet article propose d’explorer comment cette surveillance s’est transformée, en passant d’un contrôle visible des individus à un système discret fondé sur la prédiction et l’orientation des comportements (souvent à notre insu).

Source : Les Echos

Chaque matin, en ouvrant Instagram, TikTok ou Google, vous laissez des traces. Pas seulement ce que vous publiez ou ce que vous cherchez, mais aussi vos hésitations, vos clics, le temps que votre pouce s'attarde sur une vidéo, la vitesse à laquelle vous faites défiler un contenu. Par exemple, si vous restez quelques secondes de plus sur une vidéo de voyage en Italie, il y a de fortes chances que votre fil se remplisse ensuite de contenus similaires : hôtels, destinations, influenceurs voyage. Ce n’est pas un hasard.

Cette impression d’un numérique qui «nous connaît» est aujourd’hui largement partagée. Beaucoup d’utilisateurs ont déjà eu le sentiment que leurs téléphones les écoutaient ou que les plateformes devinaient leurs pensées. En réalité, il ne s’agit pas d’une surveillance magique mais d’un système d’analyse extrêmement performant, fondé sur l’accumulation massive de données et leur traitement algorithmique. Ce décalage entre ce que nous percevons et ce qui se joue réellement est au cœur du problème : nous continuons à utiliser ces services comme de simples outils alors qu’ils fonctionnent comme des dispositifs d’observation et d’anticipation de nos comportements. Ces traces numériques, apparemment anodines, alimentent un système de surveillance radicalement nouveau : invisible, automatisé, et surtout rentable.

Derrière nos heures passées sur ces plateformes, ce n’est pas une simple observation qui est exercée mais tout un système qui oriente notre vision du monde en fonction des traces numériques que nous laissons, volontairement ou non, sur le web. Comment comprendre ce basculement d’une surveillance punitive à une surveillance prédictive ?

De l’œil du gardien à l’œil de la machine

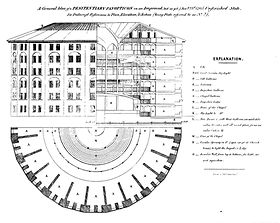

Pour comprendre ce que la surveillance est devenue aujourd’hui, il faut d’abord revenir à ses formes historiques. Dans Les théories de la surveillance (2020), (Aïm, 2020) Olivier Aïm montre que surveiller a longtemps signifié contrôler et discipliner les individus. Au XVIIIe siècle, le philosophe Jeremy Bentham imagine le panoptique : une architecture carcérale dans laquelle un seul gardien peut observer tous les détenus sans être vu. Les prisonniers ont conscience d'être observés mais pas quand, ce qui les conditionne à bien se tenir.

Source : histv, schéma du Panoptique de Jeremy Bentham

Michel Foucault, dans Surveiller et punir (1975), développe la métaphore des sociétés modernes : une société où chacun intériorise le regard du pouvoir. Cela produit une forme d’autodiscipline chez les individus qui se savent surveillés. Aujourd’hui encore, ce modèle nous parle : pensez aux caméras de surveillance dans les rues ou dans les transports. Elles incarnent une surveillance visible et identifiable. Dans ces modèles classiques, la surveillance repose sur une logique claire : elle est exercée par une autorité identifiable dans un espace donné avec un objectif clair. L’individu sait qu’il est surveillé ou du moins il peut en avoir conscience. Cette visibilité joue un rôle central car elle permet aussi une forme de contestation ou de résistance. On peut voir la caméra, identifier l’institution, comprendre la règle. C’est précisément ce qui distingue ces formes traditionnelles de surveillance des dispositifs numériques contemporains, beaucoup plus diffus et difficiles à saisir.

Mais comme le souligne Olivier Aïm (Aïm, 2020), cette vision est désormais insuffisante pour comprendre notre époque. La surveillance contemporaine ne repose plus uniquement sur des institutions ou des dispositifs visibles. Elle s’est diffusée dans nos usages quotidiens du numérique. Surtout, elle a changé de finalité. Il ne s’agit plus principalement de punir ou de contraindre. La surveillance actuelle observe pour anticiper. Elle ne cherche plus seulement à savoir ce que nous faisons, mais à prédire ce que nous allons faire. On est ainsi passé du regard du gardien à l’œil silencieux de l’algorithme : un regard omniprésent mais imperceptible.

Le « surplus comportemental » : quand nos données deviennent une ressource

Cette transformation est au cœur de ce que Shoshana Zuboff appelle le « capitalisme de surveillance » (Granjon, 2021). Prenons un exemple très concret : lorsque vous tapez une recherche sur Google ou que vous likez une publication sur Instagram, vous fournissez volontairement certaines informations. Mais en parallèle, la plateforme enregistre aussi combien de temps vous avez hésité avant de cliquer, sur quel lien vous êtes revenu ou encore à quel moment vous avez quitté la page. C’est ce que Zuboff appelle le « surplus comportemental ». Ce sont des données non nécessaires au service rendu mais qui permettent d’identifier vos comportements, vos envies, vos intentions. Ces données sont ensuite analysées pour produire des prédictions. Par exemple : êtes-vous susceptible d’acheter un billet d’avion dans les prochains jours ? De cliquer sur une publicité ? De regarder une série plutôt qu’une autre ? Ces prédictions sont ensuite vendues à des annonceurs. En soi les données ne valent rien mais c’est ce qu’elle prédit qui les rend convoitables.

Un exemple simple : vous cherchez une paire de chaussures sur un site. Pendant plusieurs jours, vous voyez apparaître des publicités pour ces mêmes chaussures, parfois même avec une impression d’urgence (« plus que deux en stock »). Ce n’est pas seulement du ciblage : c’est une tentative d’orienter votre décision. Comme l’explique Zuboff, le produit vendu n’est pas vous mais «les prédictions comportementales».

Ce modèle économique s’est étendu à de nombreux domaines. Les recommandations Netflix, les suggestions Spotify, les notifications de TikTok : tout repose sur cette logique prédictive. Ce qui rend ce système particulièrement puissant, c’est qu’il est presque invisible. Vous avez l’impression de faire des choix libres alors même que l’environnement dans lequel vous les faites est en partie structuré par des algorithmes.

L’algorithme vous connaît sans vous parler

Pour comprendre comment ces systèmes influencent nos comportements, Antoinette Rouvroy et Thomas Berns parlent de «gouvernementalité algorithmique» (Rouvroy & Berns, 2013).

Ce concept désigne une forme de pouvoir automatisée fondée sur les données. Elle fonctionne en trois temps : la collecte, le traitement puis l’utilisation des données « à des fins d’anticipation des comportements individuels ». Concrètement, cela signifie que les algorithmes construisent un profil de vous sans jamais vous poser de questions. Par exemple, vous n’avez jamais déclaré aimer les films romantiques. Pourtant, après avoir regardé plusieurs contenus similaires, Netflix commence à vous en proposer systématiquement. Ce n’est pas votre identité déclarée qui compte mais votre comportement observé. Rouvroy et Berns expliquent que ces systèmes se nourrissent de « données infra-individuelles » pour produire des profils « supra-individuels ». Autrement dit, ils ne s’intéressent pas à vous en tant que personne consciente mais à vos traces numériques. Ce qui est frappant, c’est que cette forme de pouvoir ne cherche pas à convaincre. Elle agit directement sur votre environnement. Elle modifie ce que vous voyez, ce qui vous est proposé, ce qui est mis en avant ou au contraire invisibilisé. Le résultat ? Vous avez le sentiment de choisir librement, alors que vos options ont déjà été triées, hiérarchisées, orientées. C’est toute la spécificité de cette surveillance contemporaine : elle ne vous impose rien. Elle vous guide silencieusement. Cette influence est d’autant plus efficace qu’elle repose sur un double mécanisme : les services sont perçus comme utiles, voire indispensables, tout en restant largement opaques dans leur fonctionnement. C’est précisément cette combinaison d’utilité et d’invisibilité qui rend la surveillance numérique si facilement acceptée.

Entre régulation et prise de conscience

Face à ce système, plusieurs réponses sont envisagées. Shoshana Zuboff mise sur la régulation politique. En Europe, des lois comme le RGPD tentent de redonner du contrôle aux utilisateurs : droit d’accès aux données, consentement, transparence. Mais ces mesures restent limitées. Comme le souligne Christophe Masutti (Masutti, 2022), le capitalisme de surveillance repose sur des mécanismes discrets, difficiles à encadrer. Ces limites tiennent notamment au fait que les grandes plateformes disposent d’un avantage structurel lié à l’accumulation massive de données et à leur capacité d’innovation rapide, ce qui rend difficile toute régulation durable.

D’autres chercheurs suggèrent que la solution ne peut pas être uniquement institutionnelle. Elle pourrait aussi passer par des alternatives techniques ou des changements dans nos usages. Cela peut passer par différentes formes de réappropriation de nos traces numériques comme : la désaffection de certaines plateformes, la limitation des données partagées via les paramètres de confidentialité ou encore l’adoption d’outils alternatifs plus respectueux de la vie privée. Mais la difficulté reste majeure. Comme le montrent Rouvroy et Berns, comment résister à un pouvoir qui ne nous parle pas, qui ne nous contraint pas directement, et qui agit en dehors de notre conscience ? Dans ce contexte, une première forme de résistance pourrait être la prise de conscience. Comprendre que derrière chaque recommandation, chaque publicité, chaque contenu suggéré il y a un système qui analyse et anticipe nos comportements.

Ainsi, la surveillance n’a pas disparu. Elle a simplement changé de forme. Elle n’est plus visible comme dans le modèle du panoptique. Elle est diffuse, intégrée, presque invisible. Elle ne cherche plus à punir mais à orienter. Nous évoluons aujourd’hui dans un environnement numérique qui ne se contente pas de refléter nos goûts : il les façonne progressivement. Cela ne signifie pas que nous avons perdu toute liberté. Mais cela signifie que nos choix ne se font plus dans un espace neutre. La vraie question n’est donc peut-être plus : « sommes-nous surveillés ? » Mais plutôt de savoir si nos choix nous appartiennent encore vraiment ? Et à l’heure où l’intelligence artificielle renforce encore ces capacités de prédiction, comme en témoigne déjà la capacité de ChatGPT à imiter notre style d'écriture ou les deepfakes qui envahissent les réseaux, cette question ne fait que devenir plus urgente.

Bibliographie

- Aïm, O. (2020). Les théories de la surveillance. Du panoptique aux Surveillance Studies. Armand Colin. https://doi.org/10.3917/arco.aim.2020.01 ↩

- Granjon, F. (2021). Sur L’Âge du capitalisme de surveillance. Le combat pour un avenir humain face aux nouvelles frontières du pouvoir de Shoshana Zuboff. Questions De Communication, 40, 455–472. https://doi.org/10.4000/questionsdecommunication.27359 ↩

- Rouvroy, A., & Berns, T. (2013). Gouvernementalité algorithmique et perspectives d'émancipation:Le disparate comme condition d'individuation par la relation ?. Réseaux, 177(1), 163–196. https://doi.org/10.3917/res.177.0163 ↩

- Masutti, C. (2022). Bifurquer avant l'impact : l'impasse du capitalisme de surveillance. In Framablog. ↩